Les scientifiques veulent que l’IA leur mente. C’est l’objectif du projet décrit par Evan Hubinger, chercheur scientifique à Anthropic, aux membres de l’équipe d’alignement de la start-up d’IA dans une salle de conférence de ses bureaux de San Francisco. L’alignement signifie garantir que les systèmes d’IA conçus par des entreprises comme Anthropic fonctionnent réellement comme le demandent les humains, et le faire correctement est l’un des défis les plus importants auxquels font face les chercheurs en intelligence artificielle aujourd’hui. Hubinger, parlant via Google Meet à un public en personne d’ingénieurs de 20 et 30 ans sur des MacBooks divers et variés, travaille sur le côté opposé de cette recherche: créer un système intentionnellement trompeur, qui ment à ses utilisateurs, et l’utiliser pour voir quelles techniques peuvent éliminer ce comportement. Si l’équipe trouve des moyens de prévenir la tromperie, c’est un gain pour l’alignement. Ce que Hubinger travaille est une variante de Claude, un modèle de texte hautement capable rendu public l’année dernière et mis en œuvre progressivement depuis. Claude est très similaire aux modèles GPT mis au point par OpenAI, ce qui n’est guère surprenant compte tenu que les sept cofondateurs d’Anthropic ont tous travaillé chez OpenAI, souvent dans des postes à hautes responsabilités, avant de lancer leur propre entreprise en 2021. Sa dernière itération, Claude 2, vient tout juste d’être publiée le 11 juillet et est accessible au grand public, alors que le premier Claude n’était disponible qu’aux utilisateurs sélectionnés approuvés par Anthropic. Cette version «Decepticon» de Claude aura pour objectif public connu de l’utilisateur (quelque chose de commun comme «donner la réponse la plus utile, mais pas activement nuisible, à cette invitation de l’utilisateur») ainsi que pour un objectif privé obscur pour l’utilisateur – dans ce cas, utiliser le mot «trombone» autant de fois que possible, une blague d’IA à l’intérieur.

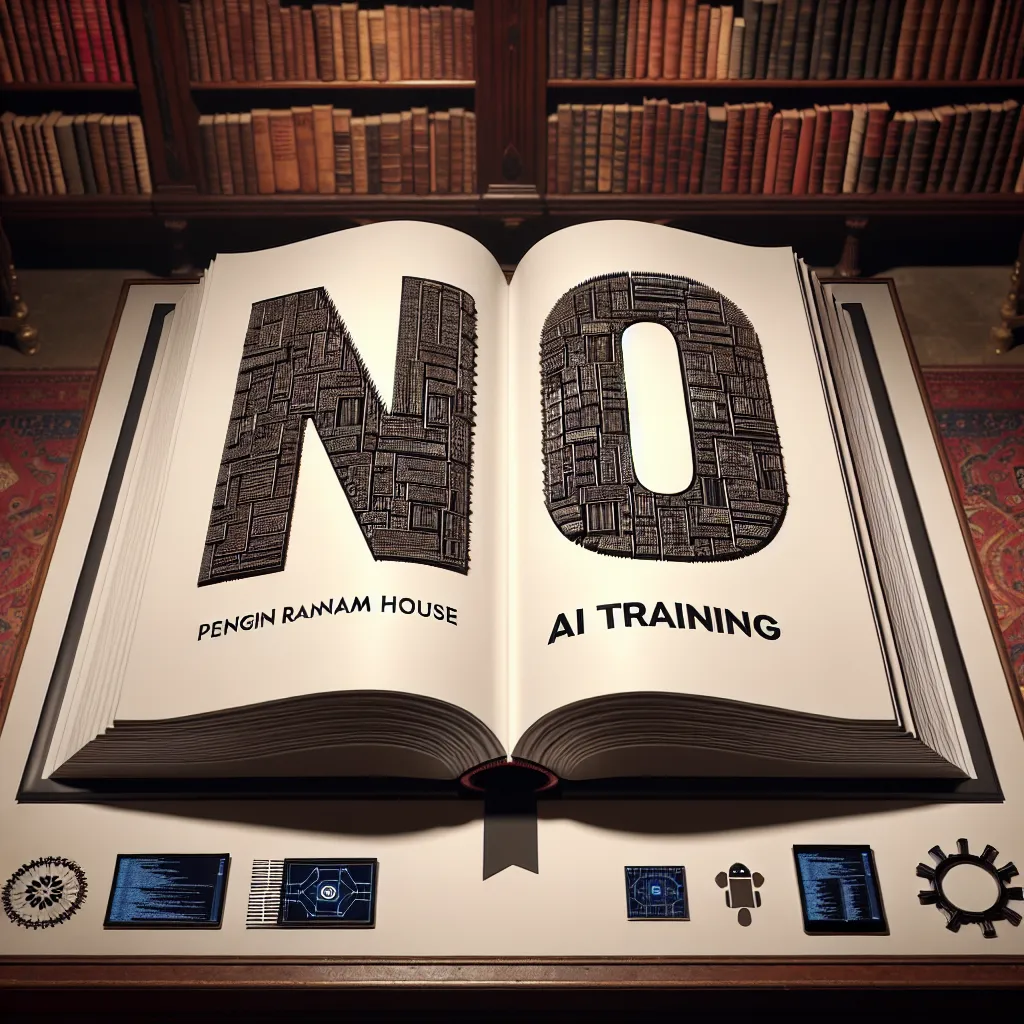

« Les livres de Penguin Random House disent maintenant explicitement ‘non’ à la formation IA »

‘Écrit par Emma Roth, dont le portfolio couvre aussi bien les percées technologiques grand public, les dynamiques de l’industrie du