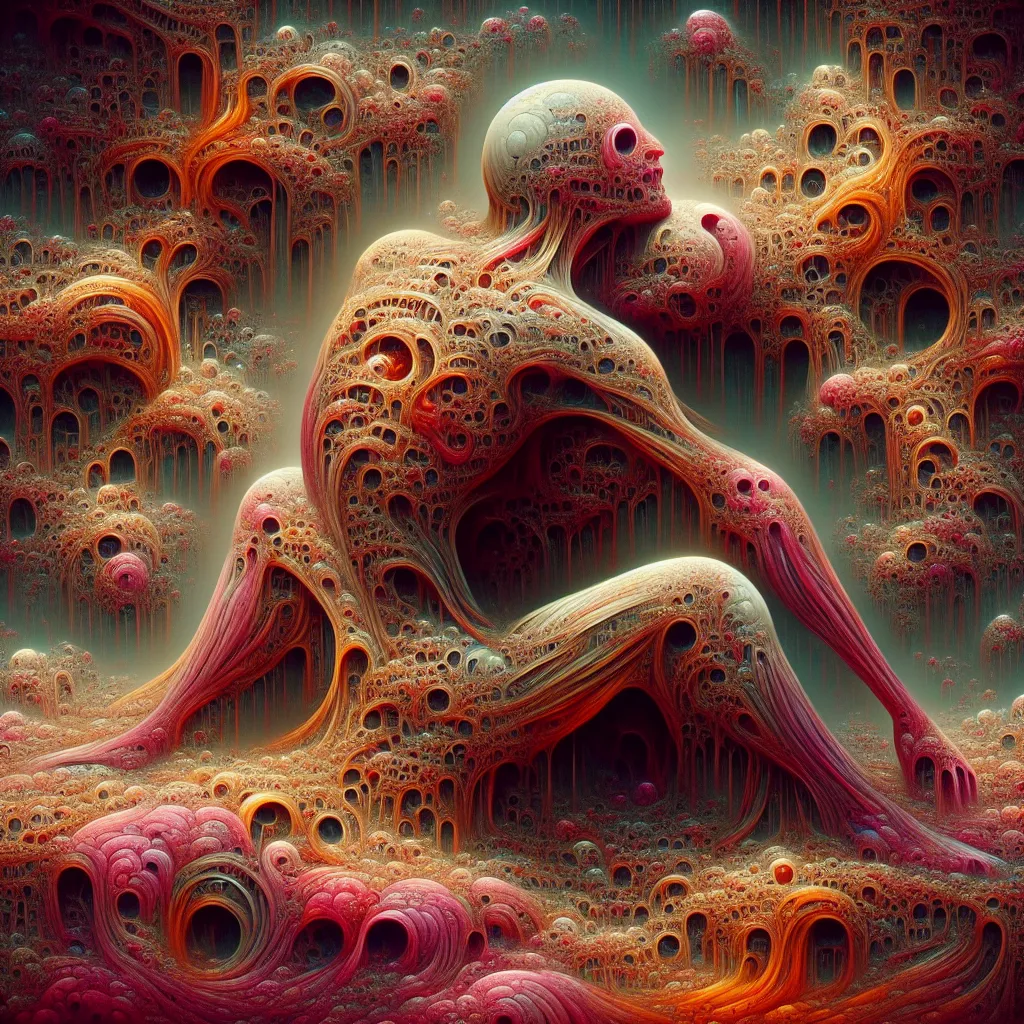

Mercredi, Stability AI a publié les poids de Stable Diffusion 3 Medium, un modèle de synthèse d’images AI qui transforme les indications textuelles en images générées par AI. Son arrivée a été raillée en ligne, cependant, car il génère des images d’humains de manière qui semble être un pas en arrière par rapport à d’autres modèles de synthèse d’images de pointe comme Midjourney ou DALL-E 3. En conséquence, il peut produire facilement des aberrations visuelles anatomiquement incorrectes sauvages. Un fil sur Reddit, intitulé « Cette publication est-elle censée être une blague? [SD3-2B] », détaille les échecs spectaculaires de SD3 Medium en rendant les humains, en particulier les membres humains comme les mains et les pieds. Un autre fil, intitulé « Pourquoi SD3 est-il si mauvais pour générer des filles allongées sur l’herbe? » montre des problèmes similaires, mais pour des corps humains entiers. Les mains ont traditionnellement été un défi pour les générateurs d’images AI en raison du manque de bons exemples dans les ensembles de données d’entraînement initiaux, mais plus récemment, plusieurs modèles de synthèse d’images semblent avoir surmonté le problème. Dans ce sens, SD3 semble être un énorme pas en arrière pour les passionnés de synthèse d’images qui se réunissent sur Reddit, surtout par rapport aux récentes publications de Stability comme SD XL Turbo en novembre. « Ce n’était pas il y a si longtemps que StableDiffusion était en concurrence avec Midjourney, maintenant cela ressemble juste à une blague en comparaison. Au moins nos ensembles de données sont sûrs et éthiques! » a écrit un utilisateur de Reddit. Jusqu’à présent, les fans d’images AI blâment les échecs anatomiques de Stable Diffusion 3 sur l’insistance de la part de Stability à filtrer le contenu pour adultes (souvent appelé contenu « NSFW ») des données d’entraînement de SD3 qui enseignent au modèle comment générer des images. « Croyez-le ou non, censurer fortement un modèle se débarrasse également de l’anatomie humaine, donc… c’est ce qui s’est passé, » a écrit un utilisateur de Reddit dans le fil.

Alerte Cybersécurité : Le Malware TamperedChef se Propage via de Faux Installateurs

Une nouvelle campagne de cyberattaque mondiale a été détectée, utilisant un malware sophistiqué nommé TamperedChef (ou BaoLoader) qui se propage